Cuando intenté entender por primera vez la red Mira, me di cuenta de que la estaba abordando de la manera equivocada. Seguí pensando en ella como otro proyecto de blockchain compitiendo por atención. Pero cuanto más leía, más sentía que era algo diferente. No intentaba ser más ruidosa o más rápida. Estaba tratando de resolver un problema silencioso pero serio que la mayoría de las personas solo nota cuando algo sale mal.

La IA es impresionante, pero comete errores con confianza. Puede sonar segura mientras es completamente incorrecta. En el uso diario, eso es inconveniente, pero en finanzas o cumplimiento, ese tipo de error puede causar un daño real. La idea detrás de Mira comenzó a tener sentido cuando dejé de preguntar cuán innovadora era y empecé a preguntar por qué necesitaba existir.

Lo que lentamente entendí es que Mira no intenta hacer que la IA sea más inteligente. En cambio, intenta hacer que la IA sea responsable. Toma lo que una IA produce y lo descompone en reclamos más pequeños. Esos reclamos se verifican a través de una red distribuida de modelos y validadores independientes. En lugar de confiar en un solo sistema, el resultado es moldeado por muchos y respaldado por incentivos económicos.

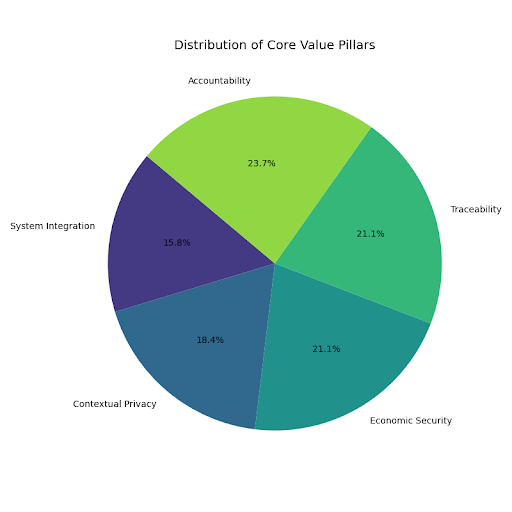

Al principio, pensé que la verificación significaba probar que algo era absolutamente cierto. Con el tiempo, me di cuenta de que eso no es realista. En instituciones reales, lo que importa más es la trazabilidad. Si algo se cuestiona más tarde, debe haber un registro de cómo se evaluó. Mira parece centrarse en eso: crear evidencia estructurada de que un proceso ocurrió de manera responsable.

La privacidad fue otro concepto que tuve que repensar. Solía imaginar la privacidad en términos absolutos: o los datos están ocultos o son públicos. Pero las finanzas no funcionan así. Diferentes personas ven diferentes capas de información. El enfoque de Mira se siente más contextual que ideológico. Se trata de probar que la validación ocurrió sin exponer todo.

Las actualizaciones que he notado sobre el proyecto no son llamativas. Hablan sobre mejorar la fiabilidad de los nodos, refinar los estándares de metadatos y fortalecer las herramientas de observabilidad. Ninguna de estas tendencias en redes sociales. Pero cuando imagino un equipo de cumplimiento dependiendo del sistema, esos detalles parecen importantes. La estabilidad importa más que la emoción.

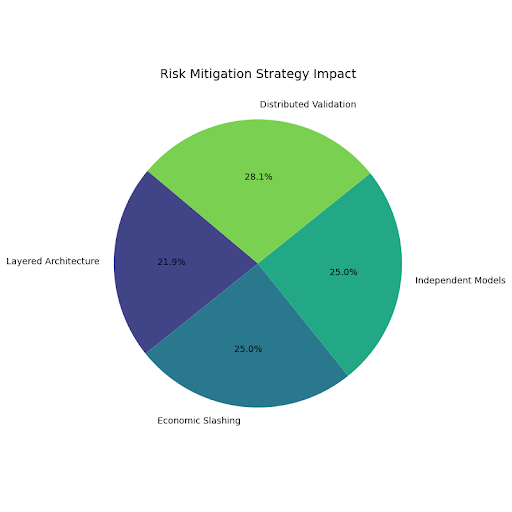

También pasé tiempo tratando de entender la mecánica de los tokens. Los validadores apuestan tokens para participar en la verificación. Si actúan deshonestamente o con descuido, arriesgan perder su apuesta. Esa estructura obliga a los participantes a tomar la verificación en serio. Se trata menos de especulación y más de responsabilidad vinculada al peso económico.

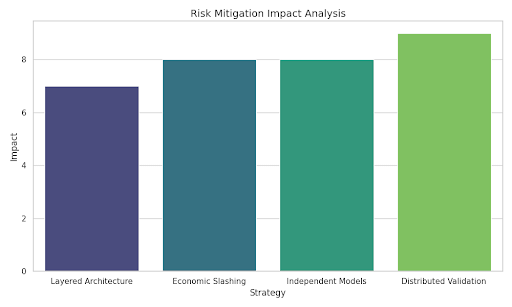

La estructura de validadores en sí es en capas. Modelos de IA independientes evalúan reclamaciones, y los validadores observan y agregan esos resultados. Esa diversidad reduce el riesgo de que el sesgo de un modelo domine el resultado. Se siente más cerca de la gestión de riesgos que de la descentralización impulsada por el bombo. Múltiples perspectivas reducen los puntos únicos de falla.

También hay compromisos, y he llegado a verlos como necesarios. La compatibilidad con los sistemas existentes, las fases de migración gradual y las elecciones de implementación prácticas muestran que el proyecto entiende la realidad. Las instituciones no reemplazan la infraestructura de la noche a la mañana. Prueban, observan e integran lentamente. Mira parece estar diseñada con esa paciencia en mente.

Mirando hacia adelante, imagino que la red se integre más en los flujos de trabajo de IA utilizados en finanzas. No de manera dramática, sino silenciosamente incrustada en flujos de trabajo que requieren auditabilidad. Mecanismos de disputa más fuertes, mejores metadatos y reglas de penalización refinadas parecen un progreso natural. Nada de esto es glamoroso, pero todo es útil.

Lo que ha cambiado para mí no es la emoción, sino la claridad. Ya no veo a Mira como una plataforma revolucionaria. La veo como una respuesta estructurada a la creciente presión de usar IA en entornos donde los errores son costosos. Está tratando de hacer que los resultados de IA sean algo detrás de lo cual las instituciones puedan respaldarse.

Cuanto más reflexiono sobre esto, más el diseño se siente intencional. Acepta compromisos, construye pacientemente y se enfoca en la responsabilidad en lugar de la atención. No me dejé llevar por grandes promesas. En cambio, estoy lentamente sintiéndome cómodo con la lógica detrás de esto. Y esa confianza silenciosa se siente más duradera que cualquier bombo podría.